Ansible vs. Kubernetes: zrozumienie różnic –

W dyskusjach o automatyzacji operacji IT nie sposób pominąć Ansible i Kubernetes. Te dwa narzędzia, choć służą różnym celom, zrewolucjonizowały proces tworzenia oprogramowania. Przyjrzyjmy się im zatem bliżej.

Czym jest Ansible?

Ansible, którego pomysłodawcą był Michael DeHaan, jest obecnie jednym z najpopularniejszych projektów na GitHub. Zyskał uznanie dzięki swojej prostocie i łatwości obsługi. Obecnie Ansible jest powszechnie uważany za standard w automatyzacji IT.

To rozwijane przez społeczność open source narzędzie przeszło znaczący rozwój, oferując rozwiązania dla operatorów, administratorów i decydentów IT w różnorodnych środowiskach technicznych.

Ansibl

Wiele znanych firm, takich jak Twitter, eBay, Verizon, NASA, ILM, Rackspace i Electronic Arts, szeroko korzysta z tego narzędzia. W uznaniu jego sukcesu, Red Hat przejął Ansible w 2015 roku.

Ansible upraszcza zarządzanie konfiguracją, wdrażanie aplikacji i automatyzację zadań. W dzisiejszych środowiskach cyfrowych specjaliści DevOps często wykorzystują je do alokacji zasobów w ramach podejścia infrastruktury jako kod (IaC) w celu płynnego dostarczania oprogramowania.

Oto kilka zastosowań Ansible:

Zalety Ansible

- Łatwość nauki i użycia: Ponieważ playbooki korzystają z YAML, są łatwe do napisania, co sprawia, że zarówno nowicjusze, jak i eksperci mogą z nich korzystać. Prosta i intuicyjna składnia ułatwia szybkie wdrożenie i płynny przepływ pracy.

- Oparte na Pythonie: To narzędzie stawia na prostotę. Jest napisane w Pythonie, jednym z najpopularniejszych i zrozumiałych języków programowania.

- Architektura bezagentowa: Ansible nie wymaga agentów. Może kontrolować zdalne hosty przez SSH bez potrzeby instalowania na nich oprogramowania. Wykorzystując playbooki i role, Ansible ułatwia zdefiniowanie idealnej infrastruktury i automatyzację ścieżki do niej.

- Podwyższone bezpieczeństwo: Dzięki SSH, Ansible priorytetowo traktuje bezpieczeństwo komunikacji między systemami, chroniąc aplikacje i infrastrukturę przed potencjalnymi zagrożeniami.

- Integracja z systemami zarządzania uwierzytelnianiem: Ansible integruje się z systemami zarządzania uwierzytelnianiem, takimi jak LDAP, Kerberos i innymi, w celu zapewnienia odpowiedniej kontroli dostępu i zwiększonego bezpieczeństwa.

- Niezawodność: Infrastruktury IT wymagają stabilności i niezawodności. Ansible ma doświadczenie w oferowaniu wysokiej wydajności i niezawodności.

Co więcej, Ansible wyróżnia się przyjaznością dla użytkownika. Zarządzanie infrastrukturą zarówno lokalną, jak i opartą na chmurze jest, jak powiedziałby Sherlock, „elementarne” dzięki Ansible.

Jak działa Ansible?

Zanim przejdziemy do szczegółów działania Ansible, przyjrzyjmy się jego komponentom:

Moduły: Gdyby Ansible było potrawą, moduły byłyby jej głównym składnikiem. Są to gotowe, małe programy, które zajmują się niemal wszystkim – od aplikacji i pakietów po pliki w systemach zewnętrznych. Ansible wdraża zdefiniowane instrukcje na systemach zewnętrznych, dostarczając jednocześnie moduły z komputera zarządzającego.

Playbooki uruchamiają powiązane moduły i usuwają je po zakończeniu zadania. Ansible ma ponad 750 (i stale rośnie) wbudowanych modułów, dzięki którym automatyzacja staje się łatwa za pomocą swoich zabaw i zadań!

Playbooki: Playbooki to zorientowane na zadania instrukcje, które używają formatu YAML w celu uproszczenia automatyzacji. Te instrukcje dyktują przepływ pracy i wykonują zadania w uporządkowany sposób. Playbooki mogą wykonywać sekwencyjne procedury, definiować środowiska i zarządzać różnymi etapami zadania.

Wtyczki: Wtyczki Ansible ulepszają zarówno wbudowaną, jak i dostosowaną funkcjonalność. System może wykonywać funkcje rejestrowania, wyświetlania zdarzeń, buforowania i kontrolera front-end i wykonuje je przed modułami w węzłach.

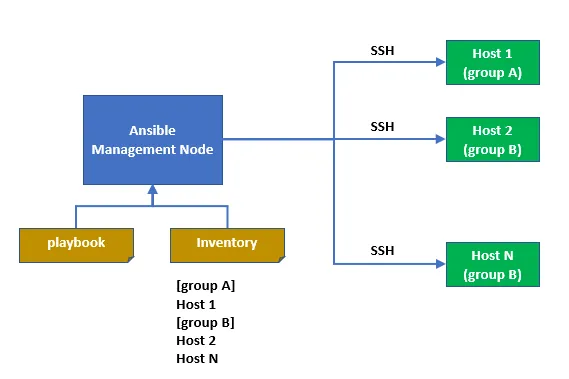

Inwentarze: Inwentarze Ansible zawierają listy hostów z ich adresami IP, serwerami i bazami danych. Zarządzanie nimi odbywa się za pomocą SSH dla systemów UNIX, Linux lub urządzeń sieciowych oraz WinRM dla systemów Windows.

Inne komponenty Ansible to API, chmura, host, sieć i CMD (baza danych zarządzania konfiguracją).

Oto jak Ansible działa w praktyce:

Po pierwsze, Ansible ma plik inwentarza z listą hostów lub maszyn. Użytkownicy mogą modyfikować ten plik, dodając serwery, którymi chcą zarządzać.

Kolejnym krokiem jest utworzenie playbooków w celu zdefiniowania idealnej infrastruktury w zarządzanych węzłach. Ansible, działając z węzła kontrolnego, który pomaga wykonywać zadania w systemie zdalnym, nawiąże połączenie SSH z tym ostatnim. Umożliwia to bezpieczną komunikację między węzłami.

Następnie wysyła i wykonuje moduły, aby zrealizować zadania określone w playbookach, doprowadzając systemy do pożądanego stanu.

Po wykonaniu zadania Ansible usuwa moduły z zarządzanych węzłów, aby uniknąć ich pozostawienia. Na koniec, dostarcza raporty o statusie realizacji zadań, pozwalając użytkownikom monitorować postęp i wyniki automatyzacji. Co więcej, Ansible może działać regularnie, aby utrzymywać i ulepszać system w czasie.

Czym jest Kubernetes?

Joe Beda, Brendan Burns i Craig McLuckie to genialne umysły stojące za Kubernetes. Pracując jako inżynierowie w Google, stworzyli narzędzie, które obecnie jest potężne w obsłudze aplikacji kontenerowych.

Początkowo Kubernetes został opracowany przez Google do zarządzania własnymi aplikacjami w środowisku produkcyjnym. Pierwsze wydanie jako projekt open source miało miejsce w 2014 roku.

W 2015 roku Google przekazał Kubernetes niezależnej od dostawcy Cloud Native Computing Foundation (CNCF), aby rozwijać technologie przetwarzania natywnego w chmurze.

Od tamtej pory Kubernetes stał się jednym z kluczowych projektów CNCF, zyskując szerokie uznanie w branży i ugruntowując swoją pozycję lidera w orkiestracji kontenerów.

Według Gartnera do 2025 roku około 85% organizacji będzie używać Kubernetes. I słusznie, jego solidny ekosystem dodatków, narzędzi i usług sprawia, że jest to wszechstronna platforma do zarządzania aplikacjami kontenerowymi.

Kubernetes przeszedł wiele ważnych aktualizacji, wprowadzając nowe funkcje, ulepszenia i poprawki błędów w każdej wersji. Stale ewoluuje i ulepsza się dzięki zaangażowanej społeczności!

Zalety Kubernetes

- Skalowalność: Łatwe skalowanie aplikacji w zależności od potrzeb.

- Przenośność: Konsekwentne wdrażanie aplikacji i zarządzanie nimi w różnych środowiskach.

- Elastyczność: Obsługa różnych środowisk wykonawczych i formatów kontenerów.

- Automatyzacja: Automatyzacja wdrażania, skalowania, monitorowania i naprawy kontenerów.

- Odporność: Wbudowana odporność na awarie i możliwości samonaprawy.

- Wsparcie DevOps: Promowanie współpracy między programistami a zespołami operacyjnymi.

- Rozszerzalność: Konfigurowalna i rozszerzalna architektura umożliwiająca integrację z innymi narzędziami.

- Społeczność i ekosystem: Duża społeczność i ekosystem dla poszerzenia funkcjonalności.

Jak działa Kubernetes?

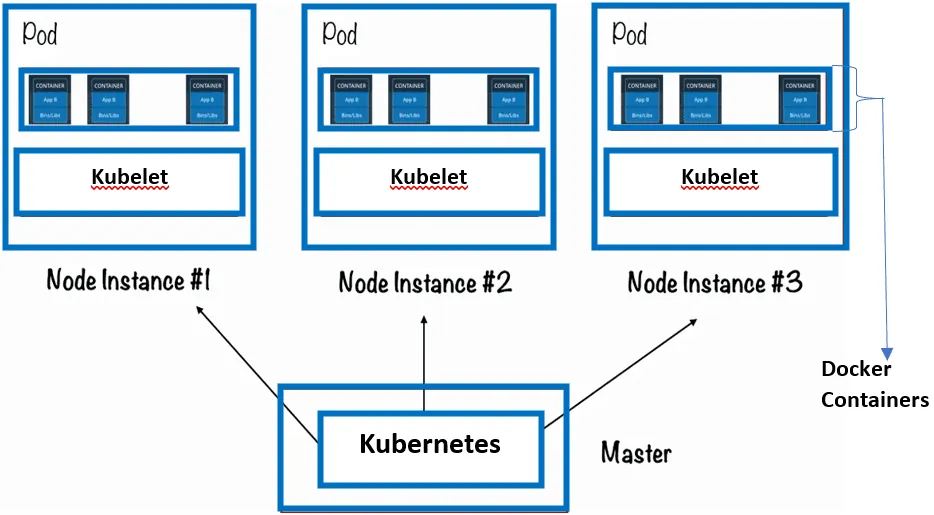

Ponieważ Kubernetes jest platformą wspomagającą orkiestrację kontenerów, pierwszym krokiem jest spakowanie aplikacji do kontenerów za pomocą narzędzi takich jak Docker. Te kontenery są samowystarczalne, zawierają całe niezbędne oprogramowanie i zależności, aby działać niezawodnie w różnych środowiskach.

Następnie za pomocą YAML lub JSON definiowany jest stan aplikacji, w tym obrazy kontenerów, wymagania dotyczące zasobów, zasady skalowania, konfiguracja sieci i pamięci masowej. Pliki z instrukcjami nazywane są manifestami.

W Kubernetes klaster jest jak zespół komputerów, zwanych węzłami, które współpracują ze sobą w celu uruchamiania aplikacji. Węzły można porównać do graczy w drużynie piłkarskiej, gdzie każdy z nich może obsługiwać wiele kontenerów, które z kolei są jak sprzęt lub wyposażenie graczy potrzebne do gry.

Komponenty Kubernetes

Najmniejszym elementem konstrukcyjnym w Kubernetes jest Pod, który przypomina przytulny domek dla jednego lub więcej kontenerów. Pody można uznać za szatnie dla graczy, gdzie spędzają czas i dzielą się zasobami, takimi jak sieć i pamięć. Każdy Pod ma unikalną nazwę i adres, co ułatwia jego identyfikację i komunikację z nim.

Wdrożenia działają jak trenerzy zarządzający zespołem. Mówią Kubernetes, ile instancji każdego Poda powinno działać w danym momencie. Tak jak trener zarządza zawodnikami na boisku, wdrożenie zarządza tworzeniem, skalowaniem i usuwaniem Podów, aby upewnić się, że aplikacja zawsze jest w pożądanym stanie.

Usługi są jak sędziowie, którzy pomagają graczom komunikować się ze sobą. Zapewniają stały adres, taki jak numer telefonu, za pomocą którego inni mogą uzyskać dostęp do aplikacji. Usługi wybierają odpowiednie pody na podstawie etykiet, takich jak pozycja gracza, i równomiernie rozdzielają ruch między nimi, zapewniając każdemu równe szanse na grę.

Do obsługi ważnych informacji, takich jak hasła czy klucze API, Kubernetes udostępnia ConfigMaps i Secrets. Są one jak skrytki, gdzie można bezpiecznie przechowywać poufne dane, a następnie wykorzystywać je w Podach i wdrożeniach, aby uzyskać dostęp do zasobów bez ujawniania ich w postaci zwykłego tekstu.

Na koniec, serwer Kubernetes API jest jak infolinia dla trenera zespołu. Zapewnia łatwy sposób zarządzania stanem zespołu za pomocą interfejsu RESTful API, z którym można wchodzić w interakcje za pomocą `kubectl` lub innych narzędzi Kubernetes. To tak, jakby mieć bezpośrednią linię do biura trenera, aby wydawać polecenia lub otrzymywać aktualne informacje o wynikach zespołu.

Porównanie funkcji: Ansible i Kubernetes

| Funkcja | Ansible | Kubernetes |

|---|---|---|

| Typ | Narzędzie do zarządzania i automatyzacji konfiguracji | Platforma orkiestracji kontenerów |

| Cel | Automatyzacja zadań IT, takich jak zarządzanie konfiguracją, wdrażanie aplikacji i alokacja systemu | Automatyzacja wdrażania, skalowania i zarządzania aplikacjami kontenerowymi |

| Architektura | Bezagentowe, wykorzystuje SSH lub WinRM do komunikacji z systemami docelowymi | Konteneryzacja, wykorzystuje architekturę węzła głównego |

| Konfiguracja | Napisane w YAML, deklaratywny język | Napisane w deklaratywnym języku YAML lub JSON |

| Skalowalność | Obsługuje zarówno małe, jak i duże infrastruktury | Przeznaczony do wdrożeń na dużą skalę |

| Wysoka dostępność | Oparta na pobieraniu, gdzie kontenery są pobierane z rejestru kontenerów do węzłów docelowych | Zapewnia wbudowane funkcje wysokiej dostępności z automatyczną zmianą harmonogramu kontenerów i przełączaniem awaryjnym węzłów |

| Praca w sieci | Zapewnia podstawowe funkcje sieciowe | Zapewnia zaawansowane funkcje sieciowe, takie jak wykrywanie usług, równoważenie obciążenia i routing oparty na DNS |

| Wdrożenie | Oparte na wysyłaniu, gdzie zmiany konfiguracji są przesyłane do systemów docelowych | Używa TLS do komunikacji, zapewnia wbudowaną izolację kontenerów i RBAC do kontroli dostępu. Aktualizacje kroczące |

| Aktualizacje | Obsługuje aktualizacje kroczące przy minimalnym przestoju | Obsługuje aktualizacje stopniowe bez przestojów |

| Kontrole kondycji | Zapewnia podstawowe kontrole kondycji systemów docelowych | Zapewnia zaawansowane kontrole kondycji kontenerów i automatyczne ponowne uruchamianie kontenerów |

| Bezpieczeństwo | Wykorzystuje SSH lub WinRM do komunikacji, wymaga odpowiedniego uwierzytelnienia i autoryzacji | Umiarkowane do dużego, wymaga zrozumienia koncepcji konteneryzacji, sieci i systemów rozproszonych |

| Rozszerzenie | Zapewnia niestandardowe moduły do rozszerzania funkcjonalności | Zapewnia niestandardowe zasoby i operatorów do rozszerzania funkcjonalności |

| Krzywa uczenia | Umiarkowany, wymaga znajomości języka YAML i podstawowych skryptów | Umiarkowany do stromego, wymaga zrozumienia koncepcji konteneryzacji, sieci i systemów rozproszonych |

Zastosowania Kubernetes

Wdrażanie aplikacji

Zarządzanie złożonymi aplikacjami w środowisku produkcyjnym wymaga bezbłędnego wykonywania wielu zadań w określonym czasie. Gdyby programiści musieli wykonywać to ręcznie, wdrożenie aplikacji zajęłoby im tygodnie.

Jednak korzystając z Kubernetes i konteneryzując aplikacje, można je wdrażać i zarządzać nimi w klastrze maszyn, zapewniając spójność i odtwarzalność. Maksymalna wydajność jest osiągana dzięki automatyzacji takich zadań jak planowanie, skalowanie i aktualizacje.

Skalowalność i równoważenie obciążenia

Aby aplikacja odniosła sukces, musi obsługiwać większy ruch bez spadku wydajności. Wbudowane funkcje Kubernetes dotyczące skalowalności i równoważenia obciążenia oferują najlepsze rozwiązanie.

Kubernetes rozdziela obciążenia w klastrze maszyn i automatycznie skaluje w górę lub w dół w zależności od potrzeb, zapewniając wysoką dostępność. Ponadto pomaga również w przydzielaniu ruchu przychodzącego do wielu instancji.

Wykrywanie usług i tworzenie sieci

Większość aplikacji nie działa samodzielnie. Muszą łączyć się z innymi aplikacjami lub usługami. Kubernetes oferuje funkcje sieciowe, które ułatwiają komunikację między kontenerami w klastrze. Aplikacje mogą również wykrywać i łączyć się z innymi usługami działającymi w grupie za pośrednictwem narzędzia opartego na DNS.

Ciągłe aktualizacje i wycofywanie

Dzięki Kubernetes aktualizacja aplikacji lub powrót do wcześniejszych wersji jest prosty. Automatyzuje on ten proces i zapewnia płynne aktualizacje bez zakłócania dostępności aplikacji, umożliwiając stopniowe aktualizacje i wycofywanie z krótkimi przestojami.

Zarządzanie infrastrukturą

Kubernetes wykorzystuje podejście deklaratywne, aby uprościć zarządzanie infrastrukturą. Pozwala użytkownikom definiować zasoby infrastruktury, takie jak pamięć, sieć i moc obliczeniową, jako kod za pomocą manifestów YAML lub JSON. Te manifesty lub pliki konfiguracyjne umożliwiają wersjonowanie, automatyzację, zarządzanie IaC (Infrastruktura jako Kod) oraz usprawniają zarządzanie złożonymi konfiguracjami infrastruktury.

Wdrażanie hybrydowe i wielochmurowe

Kubernetes zmienia zasady gry dla organizacji poszukujących adaptacji i elastyczności w swoich wdrożeniach. Dzięki zastosowaniu spójnej warstwy abstrakcji, wdrażanie i zarządzanie aplikacjami u różnych dostawców usług w chmurze lub w lokalnych centrach danych staje się wydajne.

Pozwala to użytkownikom na przyjęcie strategii hybrydowej lub wielochmurowej, wykorzystując elastyczność i przenośność kontenerów do wdrażania aplikacji i zarządzania nimi w różnych środowiskach.

Ansible i Kubernetes – cykl życia oprogramowania

| Etap w SDLC | Ansible | Kubernetes |

|---|---|---|

| Development | Zapewnia automatyczne zarządzanie konfiguracją i wdrażanie środowisk programistycznych, umożliwia kontrolę wersji plików konfiguracyjnych i ułatwia wdrażanie kodu | N/A |

| Testing | Zapewnia zautomatyzowane udostępnianie i konfigurację środowisk testowych, umożliwia łatwą replikację środowisk i obsługuje zautomatyzowane zadania testowe | N/A |

| Ciągła integracja/Ciągłe wdrażanie (CI/CD) | Ułatwia automatyczne wdrażanie aplikacji i zmiany konfiguracji, umożliwia kontrolę wersji kodu infrastruktury oraz obsługuje potoki ciągłego dostarczania i wdrażania | Ułatwia wdrażanie w kontenerach, skalowanie i zarządzanie aplikacjami, obsługuje aktualizacje stopniowe i wdrożenia bez przestojów |

| Staging/Pre-production | Zapewnia zautomatyzowane udostępnianie i konfigurację środowisk pomostowych, zapewnia spójność między środowiskami pomostowymi i produkcyjnymi oraz ułatwia testowanie środowisk podobnych do produkcyjnych | Ułatwia wdrażanie w kontenerach i skalowanie aplikacji w środowiskach przedprodukcyjnych, umożliwia testowanie aplikacji w kontenerach w odizolowanym środowisku |

| Produkcja | Ułatwia zautomatyzowane udostępnianie, konfigurowanie i zarządzanie środowiskami produkcyjnymi, umożliwia korzystanie z infrastruktury jako kodu (IaC) i wspiera wdrożenia produkcyjne | Zapewnia wdrożenia kontenerowe, skalowanie i zarządzanie aplikacjami produkcyjnymi, oferuje wbudowane funkcje wysokiej dostępności i zaawansowane funkcje sieciowe |

| Operacje/konserwacja | Automatyzuje zarządzanie dryfem konfiguracji, ciągłe monitorowanie i egzekwowanie pożądanego stanu. Obsługuje kopie zapasowe, uaktualnienia i zadania operacyjne. | Usprawnia zarządzanie aplikacjami, skalowanie, aktualizacje i zadania operacyjne, takie jak aktualizacje stopniowe i automatyczne ponowne uruchamianie aplikacji kontenerowych. |

| Rozwiązywanie problemów/Debugowanie | Umożliwia widoczność konfiguracji, rozwiązywanie problemów i wycofywanie zmian. | Umożliwia widoczność aplikacji kontenera, rozwiązywanie problemów, debugowanie oraz dzienniki/diagnostykę. |

Przykłady użycia Ansibla

Zespół IT zarządza dużą infrastrukturą, która składa się z setek serwerów w wielu centrach danych. Dzięki Ansible automatyzują spójne i bezpieczne konfiguracje i procesy serwera, takie jak zarządzanie użytkownikami, konfigurowanie zapór ogniowych i egzekwowanie zasad bezpieczeństwa.

Serwery są pogrupowane według ról i środowisk, a regularne uruchamianie playbooków zapewnia ich aktualność i zgodność. Ansible upraszcza zarządzanie konfiguracją, ogranicza pracę ręczną i poprawia zgodność z wymogami bezpieczeństwa.

Przykłady użycia Kubernetes

Zespół programistów tworzy aplikację internetową opartą na mikrousługach i wdraża ją za pomocą Kubernetes, konfigurując sieć, pamięć masową i kontenery za pomocą platformy Docker i manifestów. Skalowanie, równoważenie obciążenia, samonaprawianie i aktualizacje są obsługiwane przez Kubernetes. Skalowanie w górę lub w dół jest proste, co gwarantuje odporność na awarie i wysoką dostępność.

Ten zasób wdrożenia Kubernetes wdraża aplikację internetową z trzema replikami. Etykiety wskazują instancje aplikacji, a konfiguracje kontenerów są zdefiniowane w polu szablonu. Kubernetes zarządza skalowaniem, równoważeniem obciążenia, samonaprawianiem i stopniowymi aktualizacjami, tworząc skalowalną, odporną na błędy i wysoce dostępną aplikację.

Administracja jest łatwiejsza dzięki kontenerom i Kubernetes, zapewniając jednolite wdrożenie i łatwe skalowanie. W razie potrzeby można dodać więcej konfiguracji dla sieci, pamięci masowej i innych potrzeb.

Podsumowując

Chociaż Ansible i Kubernetes to narzędzia do automatyzacji, bezpośrednie porównywanie ich ze sobą nie byłoby całkowicie sprawiedliwe. Ansible pomaga w zarządzaniu konfiguracjami i zadaniami w szerokim zakresie systemów, podczas gdy Kubernetes jest bardziej platformą do orkiestracji kontenerów.

W przypadku tradycyjnej infrastruktury IT, Ansible byłby dobrym wyborem do obsługi konfiguracji i wdrożeń. Natomiast Kubernetes doskonale sprawdza się w nowoczesnych środowiskach natywnych dla chmury oraz w zarządzaniu aplikacjami kontenerowymi.

Obydwa narzędzia mają swoje mocne strony i mogą znacznie usprawnić automatyzację IT oraz przepływy pracy związane z wdrażaniem w swoich dziedzinach specjalizacji. Zrozumienie ich unikalnych celów i odpowiednie wykorzystanie może przynieść ogromne korzyści dla firmy.