7 typowych fałszywych oszustw, o których powinieneś wiedzieć

Najpopularniejsze oszustwa wykorzystujące technologię Deepfake

Rozpocznijmy od przyjrzenia się pewnemu „specjalnemu” wystąpieniu, rzekomo wygłoszonemu przez prezydenta Joe Bidena:

Może to dać pewne wyobrażenie o tym, jak może wyglądać oszustwo typu deepfake (w tym przypadku imitacja głosu). Do stworzenia tego konkretnego nagrania posłużyło darmowe narzędzie do klonowania głosu oparte na sztucznej inteligencji. Zaledwie kilka minut zajęło mi wygenerowanie tekstu (za pomocą ChatGPT) i przekształcenie go w mowę (imitującą głos Bidena).

Należy jednak pamiętać, że technika deepfake może być o wiele bardziej zaawansowana. Do jej zastosowania wystarczy zazwyczaj zaledwie kilka zdjęć, nagrań wideo lub audio osoby, której wizerunek jest wykorzystywany oraz wydajna karta graficzna.

Celem tego tekstu nie jest jednak analiza procesu tworzenia deepfake, ani też sposoby ich wykrywania.

W tym materiale skupimy się na krótkim wprowadzeniu do tematyki deepfake i przedstawimy kilka przykładów oszustw, przed którymi należy się mieć na baczności.

Co to są Deepfake?

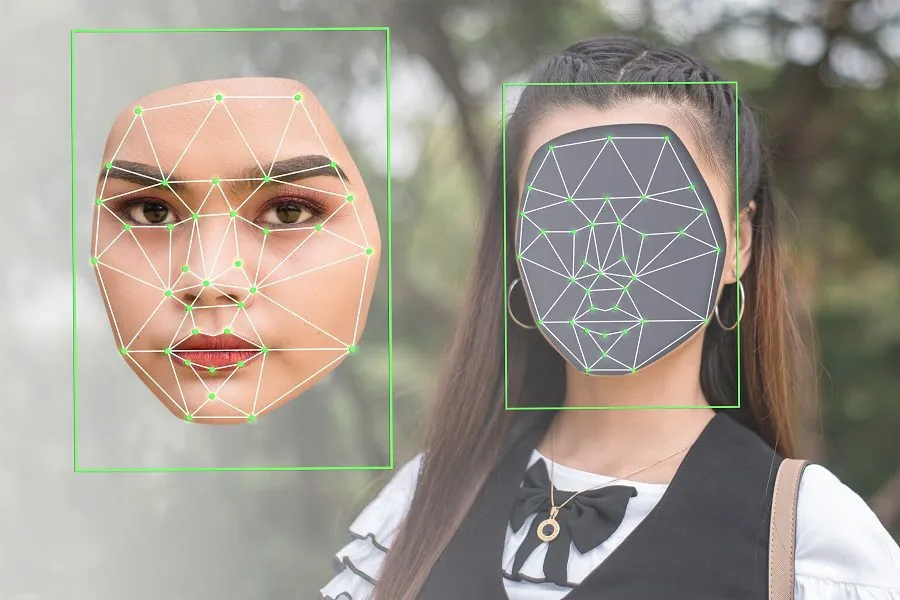

Termin deepfake jest połączeniem dwóch słów: deep (pochodzącego od głębokiego uczenia maszynowego, technologii wykorzystywanej do ich tworzenia) oraz fake (wskazującego na fałszywy charakter rezultatu).

W skrócie, algorytmy głębokiego uczenia są wykorzystywane do tworzenia bardzo realistycznych obrazów, nagrań audio lub wideo, na bazie oryginalnych materiałów o wysokiej rozdzielczości.

To klasyczny przykład deepfake, który, trzeba przyznać, jest dość przekonujący. Należy jednak pamiętać, że ma on już 5 lat, a technologia w tej dziedzinie rozwija się w bardzo szybkim tempie.

Deepfake nie zawsze służą do rozrywki lub do zademonstrowania umiejętności w zakresie sztucznej inteligencji. Jednym z poważniejszych przykładów jest sytuacja, w której "Pan Wołodymyr Zełenski" w nagraniu wzywał swoje wojska do kapitulacji w trakcie wojny rosyjsko-ukraińskiej.

Niestety, to nie jest odosobniony przypadek. Według raportu Regula Forensics z 2023 roku, 37% organizacji na całym świecie zetknęło się z oszustwami głosowymi typu deepfake, 29% padło ofiarą oszustw związanych z syntetycznymi nagraniami wideo, a 46% doświadczyło prób kradzieży tożsamości.

Zatem, deepfake to nie tylko zabawa. Jest to technologia często wykorzystywana do rozpowszechniania dezinformacji i w wielu innych, niebezpiecznych i niepokojących dla ofiar, sposobach.

Walka z treściami deepfake nie jest łatwa. Jest to efekt uboczny znacznego postępu w rozwoju sztucznej inteligencji, a także faktu, że tego typu narzędzia są powszechnie dostępne dla wszystkich.

Dlatego też, naszą najskuteczniejszą i najczęściej stosowaną obroną pozostaje świadomość.

Zastanówmy się zatem nad tymi aspektami i przyjrzyjmy się najczęstszym rodzajom oszustw typu deepfake.

Rodzaje oszustw Deepfake

W zależności od treści i celu oszustwa, technika deepfake może przybierać różne formy. Do najczęstszych należą:

- Podszywanie się pod osoby na nagraniach wideo

- Fałszywe wywiady

- Fałszywe wiadomości

- Oszustwa głosowe

- Wykorzystywanie pułapek "na miód"

- Fałszywe wsparcie klienta

- Wymyślone referencje

Poniżej omawiamy każdy z tych typów oszustw, wraz z niektórymi ich modyfikacjami.

Podszywanie się pod osoby na nagraniach wideo

To jeden z najbardziej znanych sposobów wykorzystania techniki deepfake. W ramach tego oszustwa ofiary oglądają fałszywe nagrania wideo, w których występuje osoba znana publicznie. Do najczęstszych ofiar należą głowy państw (na przykład deepfake Obamy), popularne gwiazdy Hollywood lub prezesi znanych firm.

Łatwość, z jaką można ich obrać za cel, wynika z publicznej dostępności ich zdjęć, nagrań przemówień itp. Technologia deepfake bardzo dobrze radzi sobie z analizą różnych danych wejściowych, uwzględniając odmienne zakresy emocji, kąty twarzy, warunki oświetleniowe, tła i wiele innych czynników.

Celem takiego podszywania się może być zwykła rozrywka, próba szantażu, motywacja polityczna, zniesławienie, bądź jakikolwiek inny cel.

W rzadkich przypadkach można spotkać się z fałszywymi nagraniami wideo, przedstawiającymi członków rodziny proszących o pieniądze lub o dostęp do cennych przedmiotów.

Fałszywe wywiady

Fałszywe wywiady przeprowadzane przy użyciu technologii deepfake najczęściej pojawiają się w przypadku zdalnych rekrutacji. Oszustwa tego typu wykorzystują fałszywe nagrania wideo w czasie rzeczywistym, które są odtwarzane podczas rozmów prowadzonych za pośrednictwem programów do wideokonferencji (takich jak Zoom).

Oprócz ryzyka zatrudnienia niekompetentnego kandydata, firma naraża się na ujawnienie swoich zasobów nieuczciwej osobie. Takie działania mogą negatywnie wpłynąć na jej działalność i na interesy całego kraju.

Celem fałszywych wywiadów może być również zarabianie na wyłudzaniu walut o dużej wartości.

Z drugiej strony, oszuści mogą pobierać od niewinnych kandydatów opłatę za udział w rozmowie kwalifikacyjnej, dając im złudną nadzieję na spotkanie z potencjalnymi pracodawcami, dające im szansę na zdobycie wymarzonej pracy.

Fałszywe wiadomości

Fałszywe wiadomości to jedno z najczęściej spotykanych oszustw wykorzystujących technologię deepfake. Tego typu internetowe kampanie dezinformacyjne mogą stanowić poważne zagrożenie w trudnych sytuacjach, takich jak zamieszki lub konflikty zbrojne.

Co więcej, mogą one oczerniać osoby publiczne, gdy ich fałszywe wizerunki w wypowiedziach publikują komentarze, których w rzeczywistości nigdy nie wygłosiły.

W rozprzestrzenianiu tego typu dezinformacji pomagają media społecznościowe i platformy streamingowe, takie jak YouTube. To powoduje, że tego rodzaju wiadomości rozprzestrzeniają się w błyskawicznym tempie. W efekcie, wielu użytkowników traci orientację i ma problem z odróżnieniem prawdziwych informacji od fałszywych.

Oszustwa głosowe

Podobnie jak w przypadku fałszywych nagrań wideo i obrazów, syntetyczny głos jest kolejnym elementem, który często pojawia się w zestawieniu z tego typu oszustwami opartymi na zaawansowanej technologii.

Pewnego razu Jennifer DeStefano, mieszkanka Arizony, usłyszała w słuchawce płacz swojej 15-letniej córki. Męski głos żądał okupu w wysokości miliona dolarów za jej uwolnienie. Matka była przekonana, że jej córka jest w niebezpieczeństwie. Zanim zdążyła przemyśleć, w jaki sposób dokonać płatności, jej znajoma skontaktowała się z jej mężem, potwierdzając, że córka jest bezpieczna.

Pani DeStefano opowiadała później o tym doświadczeniu. Przyznała, że całkowicie uwierzyła w to, co usłyszała. Nie tylko ze względu na samo brzmienie głosu, ale również ze względu na sposób, w jaki zazwyczaj wypowiadała się jej córka.

Takie klonowanie głosu jest możliwe dzięki wykorzystaniu próbek audio ze źródła.

Pułapki "na miód"

Zgodnie z tradycyjną definicją, pułapka "na miód" polega na zachęcaniu ofiary do nawiązania kontaktu w celu wyłudzenia poufnych informacji. Pułapki tego typu są zazwyczaj wymierzone w osoby zajmujące wysokie stanowiska, takie jak żołnierze, urzędnicy państwowi, politycy itd.

Technologia deepfake sprawiła, że pułapki tego typu stały się powszechnie dostępne w Internecie i każdy może je zastawiać na szeroką skalę. Oznacza to, że ofiara może otrzymywać za pośrednictwem mediów społecznościowych zaproszenia do relacji z atrakcyjnymi partnerami. Relacje te szybko przybierają intymny charakter, a ich ostatecznym celem jest wymuszenie finansowe lub wydobycie informacji.

Tego rodzaju oszustwa typu deepfake często są starannie zaplanowanymi operacjami, które przebiegają zgodnie z ustalonym planem, prowadząc ofiarę prosto w sidła.

Obsługa klienta

Oszustwa związane z obsługą klienta są bardzo powszechne. Prawdopodobnie każdy z nas spotkał się z oszustwem, w którym "pracownik Microsoftu" prosi nas o zapłatę za "usunięcie poważnych" problemów z naszym komputerem.

Przed pojawieniem się technologii deepfake, oszustów często demaskował ich akcent lub nietypowe wzorce mowy. Teraz oszuści mają do dyspozycji sztuczną inteligencję, która w łatwy sposób pozwala im wprowadzić ofiary w błąd i przekonać je, że rozmawiają z autentycznym przedstawicielem firmy.

Referencje

Wielu z nas przed zakupem produktu zapoznaje się z opiniami klientów. Podobnie, oglądanie recenzji wideo stało się nawykiem, który do tej pory okazywał się pomocny.

Oszustwa tego typu polegają na wykorzystaniu nagrań, na których fałszywe osoby rekomendują słaby produkt. W ten sposób oszuści mogą wpływać na decyzje zakupowe i doprowadzić do tego, że klienci zmarnują swoje pieniądze i czas.

Jest ich o wiele więcej!

Co oprócz tekstu widzimy w Internecie?

Można śmiało stwierdzić, że są to nagrania wideo, obrazy i dźwięk. Wszystkie te elementy mogą zostać zmanipulowane za pomocą sztucznej inteligencji, co w niedalekiej przyszłości sprawi, że Internet stanie się wylęgarnią oszustw. Co więcej, tworzenie deepfake'ów staje się coraz prostsze, co sprawia, że przeciętnemu użytkownikowi Internetu coraz trudniej jest zdobyć prawdziwe informacje.

W sytuacji, gdy nie ma skutecznych metod powstrzymywania tego powszechnego nadużywania technologii, powinniśmy przynajmniej starać się być na bieżąco.

PS: Jeśli szukacie rozrywki, istnieją również aplikacje deepfake, które pozwalają tworzyć jedne z najlepszych memów, podbijających media społecznościowe.