Cześć! 🙋Mamy dla Ciebie dzisiaj następujące aktualizacje produktów! 📣

OpenAI, Google, Microsoft i Anthropic współpracują w celu uregulowania rozwoju sztucznej inteligencji

Czterech czołowych graczy w dziedzinie sztucznej inteligencji. OpenAI, Microsoft, Google i Anthropic połączyły siły, aby ustanowić Forum modeli Frontier. Misją tego organu branżowego jest zapewnienie bezpiecznego i odpowiedzialnego rozwoju modeli sztucznej inteligencji i uczenia maszynowego, znanych jako „frontier AI”.

OpenAI wprowadził termin „frontier AI” w artykule opublikowanym 6 lipca. Odnosi się on do modeli, które wiążą się z ryzykiem dla bezpieczeństwa publicznego.

Główne cele tego forum są następujące;

- Postępy w badaniach nad zapewnieniem bezpieczeństwa sztucznej inteligencji.

- Identyfikacja praktyk w zakresie opracowywania i wdrażania modeli granicznych.

- Współpraca z interesariuszami.

- Wspieranie aplikacji, które stawiają czoła wyzwaniom.

Ustanowienie Frontier Model Forum podkreśla zarówno zaangażowanie branży w rozwiązywanie problemów związanych z bezpieczeństwem, jak i proaktywne podejście giganta technologicznego do zarządzania przepisami poprzez inicjatywy.

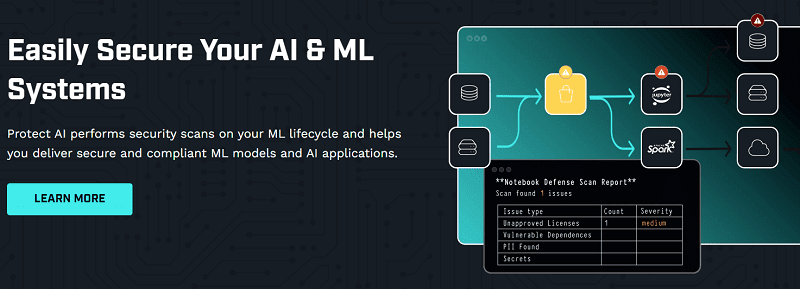

Chroń sztuczną inteligencję przeprowadza skanowanie bezpieczeństwa i chroni systemy uczenia maszynowego (ML) i sztucznej inteligencji, aby dostarczać bezpieczne i zgodne modele uczenia maszynowego i aplikacje sztucznej inteligencji. Zapewnia widoczność zagrożeń, testowanie bezpieczeństwa i korygowanie systemów AI i ML.

Firma pozyskała 35-milionową rundę finansowania Series A, prowadzoną przez Evolution Equity Partners z udziałem Salesforce Ventures i obecnych inwestorów. Do tej pory firma zebrała łącznie 48,5 mln USD, aby pomóc organizacjom chronić systemy ML i aplikacje AI przed wyjątkowymi lukami w zabezpieczeniach, naruszeniami danych i pojawiającymi się zagrożeniami.

Rozwiązanie Protect AI NB Defense zabezpiecza notebooki Jupyter Lab, zwiększając produktywność i współpracę. Zmniejsza ryzyko, skanuje w poszukiwaniu problemów z bezpieczeństwem i dostarcza cennych informacji. Narzędzia AI automatycznie zabezpieczają łańcuch dostaw oprogramowania ML, skanują i naprawiają elementy.

Trustmi zabezpiecza 17 mln USD na skalowanie swoich płatności Technologia zapobiegania oszustwom

Zaufaj mi wykorzystuje sztuczną inteligencję, uczenie maszynowe i dane do proaktywnego identyfikowania transakcji i zapobiegania im. Platforma oferuje szereg możliwości, które umożliwiają firmom wzmocnienie bezpieczeństwa płatności.

Możliwości te obejmują:

- Monitorowanie płatności za wszelkie działania, takie jak transakcje z udziałem krajów wysokiego ryzyka lub płatności od nieznanych dostawców.

- Weryfikacja płatności poprzez porównanie ich ze źródłami danych, w tym z czarnymi listami kart kredytowych i listami zgodności dostawców.

- Udostępnienie użytkownikom opcji kontroli płatności, które umożliwiają im zatwierdzanie lub odrzucanie płatności przy jednoczesnym ustalaniu limitów dla poszczególnych dostawców.

Firma zabezpieczyła 17 milionów dolarów w rundzie Serii A, zwiększając całkowitą inwestycję do 21 milionów dolarów, na czele z Cyberstarts z udziałem Zeev Ventures.

Aby uzyskać więcej aktualizacji, sprawdź kategorię Najnowsze technologie.