13 popularnych modeli AI do tworzenia generatywnych aplikacji AI

Czy pragniesz stworzyć własne, unikatowe aplikacje oparte na sztucznej inteligencji generatywnej? Przygotowaliśmy listę modeli AI, które będą doskonałym punktem startowym w tej fascynującej podróży.

Modele AI to nic innego jak specjalistyczne architektury sieci neuronowych, które z wyjątkową skutecznością realizują określone zadania. Wśród nich znajdziemy konwolucyjne sieci neuronowe, idealne do klasyfikacji i segmentacji obrazów, generatywne modele językowe o potężnych możliwościach, modele dyfuzyjne do generowania grafik, i wiele innych.

W ostatnim czasie ogromną popularność zdobyły modele AI przeznaczone do zastosowań generatywnych, obejmujących przetwarzanie obrazu, mowy, tekstu i innych. Ten dynamiczny wzrost jest możliwy dzięki postępowi w dziedzinie badań oraz coraz łatwiejszemu dostępowi do zaawansowanych mocy obliczeniowych.

Poniżej znajdziesz zwięzłe podsumowanie popularnych modeli sztucznej inteligencji, które omówię w dalszej części artykułu.

| Model | Kluczowe możliwości |

|---|---|

| GPT-4 | Tworzenie zaawansowanych aplikacji LLM. |

| Llama | Model wielkojęzykowy typu open source do budowy aplikacji LLM. |

| Sokół | Wszechstronne zastosowania w NLP, od chatbotów po wspomaganie kodowania. |

| Stabilna dyfuzja | Generowanie obrazów z tekstu, retusz, modyfikowanie i skalowanie grafik. |

| DALL-E 2 | Generowanie obrazów na podstawie opisów tekstowych. |

| Szept | Rozpoznawanie mowy, tłumaczenie językowe i identyfikacja języka. |

| StableLM | Lekki, otwarty model językowy o szerokich możliwościach. |

| CLIP | Zróżnicowane zadania NLP, takie jak odpowiadanie na pytania, streszczanie i generowanie tekstów. |

| InternLM | Otwarty model wielkojęzykowy do tworzenia aplikacji opartych na LLM. |

| Segmentuj dowolny model | Segmentacja obrazu w trybie zero-shot, bez konieczności dodatkowego trenowania. |

| WaveGAN | Generowanie dźwięku. |

| CycleGAN i pix2pix | Transformacja obrazu na obraz. |

| BioGPT | Generowanie i analiza tekstów biomedycznych. |

Od grafiki generowanej przez sztuczną inteligencję po personalizowanych asystentów kodowania – wachlarz generatywnych aplikacji AI, które możesz stworzyć, jest naprawdę szeroki. Poniżej przedstawiamy kilka intrygujących modeli sztucznej inteligencji, które warto poznać, wraz z ich kluczowymi funkcjami.

Zaczynajmy!

GPT-4

Od planowania podróży po tworzenie listów motywacyjnych idealnie dopasowanych do wymagań konkretnych stanowisk - ChatGPT stał się nieodłącznym elementem naszej codzienności. GPT-4, jego następca, to jeszcze potężniejszy model językowy.

Jest to najnowocześniejszy system sztucznej inteligencji od OpenAI, który oferuje ulepszone możliwości rozumowania i wydajność w porównaniu do ChatGPT.

Poniżej przedstawiamy techniczne omówienie działania GPT-4 i jego potencjału w tworzeniu aplikacji.

Dostęp do interfejsu ChatGPT można uzyskać za pomocą bezpłatnego konta OpenAI. Jednak, aby korzystać z GPT-4, konieczna jest subskrypcja ChatGPT Plus.

Oto kilka przykładowych aplikacji, które można zbudować wykorzystując duże modele językowe:

- Indywidualnie dostosowane chatboty

- Usprawnione platformy CRM

- Systemy odpowiadające na pytania oparte na unikalnych zbiorach danych

- Inne zadania, takie jak streszczanie i generowanie tekstów

Teraz przejdziemy do omówienia niektórych otwartych modeli językowych (open source).

Lama

Meta AI w lutym 2023 roku udostępniła Lama, bazowy model językowy z 65 miliardami parametrów. Następnie pojawiła się LLama 2, oferująca znaczące ulepszenia w porównaniu z poprzednią wersją. Dostępne są następujące warianty:

- Czat Lamy: Dostrojona Lama 2

- Kod Lamy: Zbudowany na podstawie Lamy 2, trenowany na ponad 500 miliardach tokenów kodu, obsługuje generowanie kodu w najpopularniejszych językach programowania

Modele Llama możesz pobrać i używać po złożeniu prośby o dostęp. Zachęcamy do zapoznania się z tym samouczkiem, który wyjaśnia, jak używać LLama 2 w aplikacjach Python:

Sokół

Sokół to kolejny model językowy typu open source, stworzony przez Instytut Innowacji Technologicznych (ZEA). Modele z pakietu Falcon LLM są otwarte i dostępne w trybie open access, dzięki czemu można z nich korzystać przy tworzeniu aplikacji opartych na LLM.

Obecnie dostępne są cztery wersje modeli: 1,3B, 7,5B, 40B i 180B. Model 180B, szkolony na zbiorze danych o wielkości 3,5 T tokenów, wykazuje lepsze wyniki w wielu testach porównawczych. Falcon LLM skutecznie konkuruje z innymi wiodącymi rozwiązaniami LLM typu open source.

Model Falcon 180B typu open source osiąga wydajność zbliżoną do GPT-4. Zachęcamy do zapoznania się z tym samouczkiem, który omawia Falcona 180B, jego zastosowanie, wymagania sprzętowe oraz porównanie z GPT-4:

Stabilna dyfuzja

Stabilna dyfuzja to model konwertujący tekst na obraz, służący do generowania grafik i innych kreatywnych zastosowań AI. Może być także wykorzystany do skalowania obrazów i retuszu.

Stabilna dyfuzja XL, która ukazała się w lipcu 2023 roku, oferuje szereg usprawnień, m.in.:

- generowanie opisowych obrazów przy użyciu znacznie krótszych promptów

- możliwość generowania tekstu w obrazach

- retusz i modyfikacja obrazów

- interakcja z oryginalnym obrazem w celu wygenerowania jego wariantów

Jeżeli chcesz dowiedzieć się, jak działają modele dyfuzyjne – technologia stojąca za tymi niezwykłymi możliwościami – zapraszamy na bezpłatny kurs Jak działają modele dyfuzyjne od DeepLearning.AI.

DALL-E 2

DALL-E 2 od OpenAI to kolejny popularny model generowania obrazów na podstawie tekstu. Pozwala na tworzenie realistycznych obrazów i grafik na podstawie opisu w języku naturalnym.

Można go używać w następujących celach:

- Generowanie obrazów na podstawie opisów tekstowych

- Modyfikacja i retusz obrazów

- Generowanie wariacji obrazów

Dostęp do DALL-E 2 można uzyskać poprzez API OpenAI lub interfejs webowy OpenAI Labs.

Szept

OpenAI Szept to model rozpoznawania mowy, który znajduje zastosowanie w wielu dziedzinach, m.in.:

- identyfikacja języka

- transkrypcja plików audio

- tłumaczenie mowy

Poniżej znajduje się samouczek, który pokazuje, jak za pomocą interfejsu API OpenAI Whisper dokonać konwersji mowy na tekst:

Aby przetestować ten model, możesz zainstalować szept (openai-whisper) przy użyciu pip i uzyskać dostęp do API z poziomu skryptu Pythona w celu transkrypcji plików audio. Ponadto, możesz użyć innych zaawansowanych modeli językowych do streszczenia transkrypcji i stworzenia potoku audio → streszczenie.

StableLM

StableLM to pakiet otwartych LLM od Stability AI. Obecnie dostępne są modele z 3 i 7 miliardami parametrów. W przyszłości mają pojawić się większe modele, z 15 do 65 miliardami parametrów.

Jeżeli chcesz poeksperymentować z lekkimi, otwartymi LLM w swoich aplikacjach, warto wypróbować StableLM.

CLIP

CLIP (Contrastive Language–Image Pre-training) to multimodalna sieć neuronowa, trenowana na ogromnym zbiorze danych zawierającym pary (tekst, obraz). Model, wykorzystując dane języka naturalnego, uczy się semantyki obrazów na podstawie ich opisów. CLIP potrafi przewidzieć najbardziej odpowiedni opis tekstowy dla danego obrazu.

Dzięki CLIP możliwe jest przeprowadzenie klasyfikacji obrazów w trybie „zero-shot”, bez konieczności kosztownego wstępnego szkolenia i dostrajania. Dodatkowo, możliwości baz danych wektorowych CLIP można wykorzystać do tworzenia interesujących aplikacji w zakresie:

- wyszukiwania tekstu na obraz i obrazu na obraz

- odwrotnego wyszukiwania obrazów

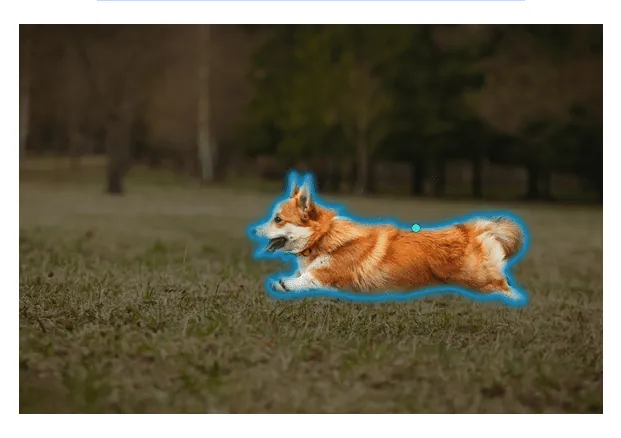

Segmentuj dowolny model

Segmentacja obrazu to proces identyfikacji pikseli, które należą do określonego obiektu na obrazie. Meta AI udostępniła Segmentuj dowolny model (SAM), który można wykorzystać do segmentacji dowolnego obrazu i wycinania z niego obiektów.

Źródło obrazu: Segmentuj wszystko

Źródło obrazu: Segmentuj wszystko

Za pomocą odpowiednich promptów można określić, co ma być segmentowane na obrazie. SAM obsługuje obecnie następujące prompt: ramki ograniczające, maski oraz punkty pierwszego planu i tła. Model ten cechuje się także wysoką skutecznością generalizacji zerowej na wcześniej nieznanych obrazach, co eliminuje potrzebę dodatkowego szkolenia.

Wypróbuj model SAM w swojej przeglądarce!

InternLM

InternLM to otwarty model językowy. Możesz przetestować podstawowy model 7B oraz model czatu typu open source. Model ten obsługuje okno kontekstowe 8K, interpreter kodu oraz możliwość wywoływania funkcji.

InternLM jest również dostępny w bibliotece transformerów HuggingFace. Możesz skorzystać z lekkiej platformy przedtreningowej, a także tworzyć i wdrażać aplikacje z użyciem LMDeploy. Dzięki temu InternLM pozwala tworzyć kompleksowe, generatywne aplikacje NLP.

WaveGAN

WaveGAN to model generowania dźwięku. Pomaga w syntezie dźwięku z próbek prawdziwych danych audio.

WaveGAN można wytrenować na dowolnym zbiorze plików audio, a następnie syntetyzować dźwięk bez rozbudowanego przetwarzania wstępnego.

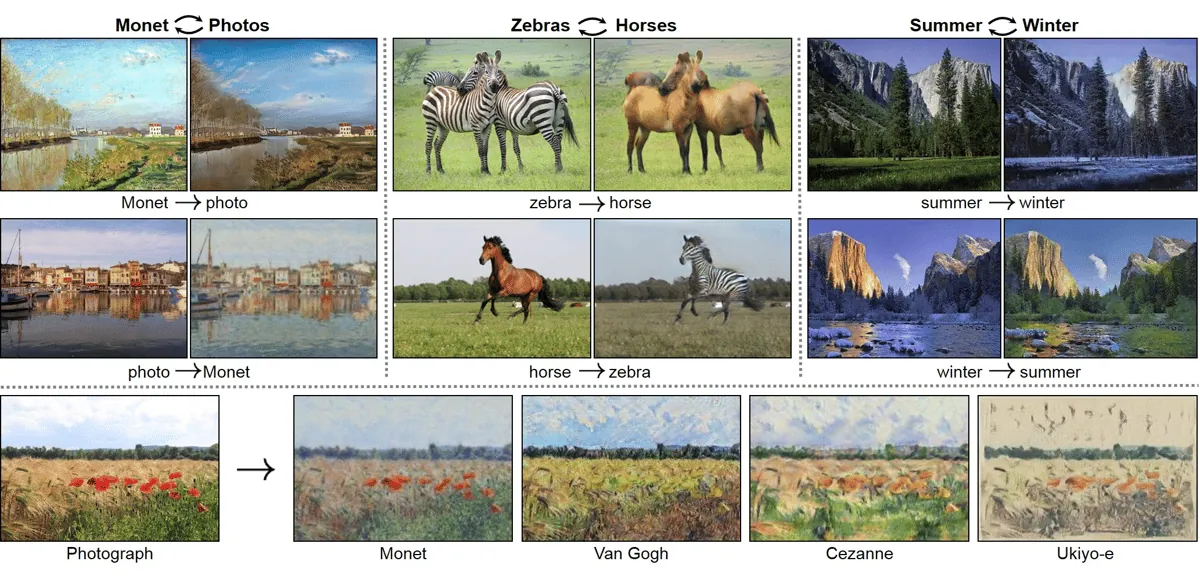

CycleGAN i Pix2Pix

Omówiliśmy do tej pory modele zamiany mowy na tekst, tekstu na obraz oraz inne modele dla różnych zadań przetwarzania języka naturalnego. A co w sytuacji, gdy chcemy dokonać transformacji obrazu na obraz? W tym przypadku można skorzystać z CycleGAN, aby nauczyć się mapowania domeny źródłowej na domenę docelową i dokonać translacji obrazu na obraz.

Na przykład, mając zdjęcie jeziora zimą, możemy chcieć przekształcić ten sam obraz w scenerię letnią. Na zdjęciu konia można zastąpić zwierzę zebrą, zachowując tło. CycleGAN doskonale sprawdzi się w takich zastosowaniach.

Do translacji obrazu na obraz można użyć modelu pix2pix. Jego kluczowe możliwości obejmują:

- rekonstrukcję obiektów na podstawie map krawędziowych oraz

- kolorowanie obrazów

Implementacje CycleGAN i pix2pix w PyTorch znajdziesz na GitHubie.

BioGPT

BioGPT od Microsoftu to model transformatorowy, który można wykorzystać do analizy danych biomedycznych i generowania tekstów. Wykorzystuje implementacje modelu sekwencja-sekwencja, dostarczone przez Fairseq.

Fairseq od Facebook Research (obecnie Meta AI) to zestaw narzędzi zapewniających implementacje modeli sekwencja-sekwencja dla takich zadań, jak:

- modelowanie języka

- tłumaczenie

- streszczanie

Dostępne są zarówno wstępnie wytrenowane modele, jak i precyzyjnie dostrojone punkty kontrolne. Model możesz pobrać z podanego URL lub z centrum HuggingFace.

Modele BioGPT są również częścią biblioteki transformerów HuggingFace. Jeżeli więc pracujesz w sektorze biomedycznym, możesz wykorzystać BioGPT do tworzenia dedykowanych aplikacji.

Podsumowanie

Mam nadzieję, że zaprezentowane modele okażą się pomocne w budowie Twoich generatywnych aplikacji AI. Chociaż lista ta nie jest wyczerpująca, omówiliśmy niektóre z najpopularniejszych modeli, które można wykorzystać do tworzenia aplikacji generujących tekst i dźwięk, transkrypcji mowy na tekst, wyszukiwania obrazów i wielu innych.

Tworząc aplikacje z użyciem dużych modeli językowych, należy pamiętać o potencjalnych pułapkach, takich jak nieprecyzyjne informacje i halucynacje. Dostrajanie modeli może być obarczone ograniczeniami, ponieważ proces ten często wymaga sporych zasobów.

Jeśli jesteś programistą, to idealny czas, by dołączyć do rewolucji AI i zacząć tworzyć fascynujące aplikacje! Zachęcamy do eksperymentowania z tymi modelami w Google Colab lub innych platformach do analizy danych.