8 sposobów, w jakie sztuczna inteligencja zaciera granicę między rzeczywistością a fantazją

Ostatnie osiągnięcia w dziedzinie modeli językowych, transformacji tekstu na obraz oraz tekstu na wideo umożliwiły sztucznej inteligencji kreowanie rezultatów o niespotykanym dotąd poziomie realizmu. W wielu przypadkach są one tak przekonujące, że trudno odróżnić je od treści stworzonych przez ludzi.

Choć ten postęp stanowi ważny krok w rozwoju technologii, jednocześnie zaciera granicę pomiędzy tym, co rzeczywiste, a tym, co zmyślone. Obrazy, teksty i materiały wideo wygenerowane przez sztuczną inteligencję tworzą wirtualne treści, które mogą zaciemniać autentyczne doświadczenia. Poniżej przedstawiono sposoby, w jakie sztuczna inteligencja konstruuje iluzję rzeczywistości.

1. Persony stworzone przez sztuczną inteligencję bywają traktowane jak prawdziwi ludzie

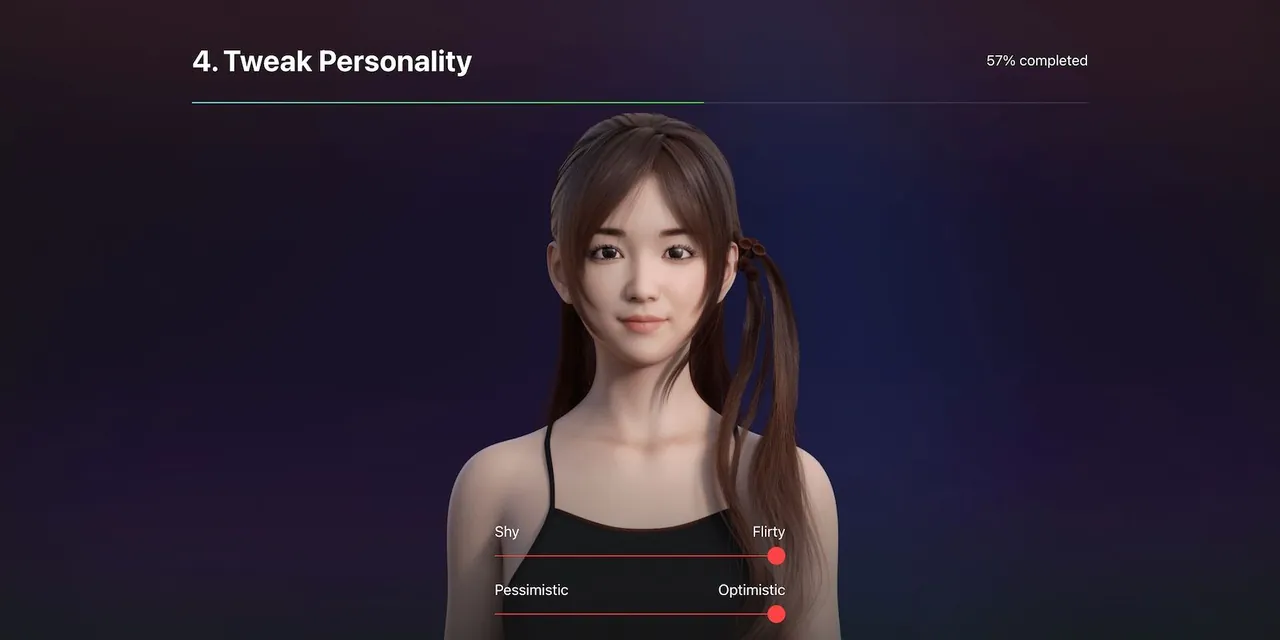

Aplikacje oferujące wirtualnych partnerów AI stają się coraz bardziej zaawansowane. Symulują relacje romantyczne, wykorzystując do tego postaci wygenerowane przez sztuczną inteligencję, które użytkownicy mogą dostosowywać do swoich indywidualnych preferencji. Niektórzy preferują postacie o złożonej osobowości, przypominające ludzi, podczas gdy inni tworzą wirtualne kopie postaci fikcyjnych.

Wiele osób korzysta z symulatorów randek w celu zwalczania uczucia samotności. Aplikacje oparte na zaawansowanej technologii przetwarzania języka naturalnego (NLP) i dużych modelach językowych (LLM) naśladują naturalne ludzkie rozmowy. W rezultacie użytkownicy odczuwają, że faktycznie "nawiązują więź" z tymi wirtualnymi partnerami.

Paradoksalnie, aplikacje oferujące wirtualnych partnerów AI mogą pogłębiać izolację społeczną, utrwalając szkodliwe przekonania na temat relacji międzyludzkich. Użytkownicy zaczynają oczekiwać partnerów, którzy idealnie pasują do ich wyobrażonych postaci AI. Niektóre osoby posuwają się nawet do ślubu ze swoimi wirtualnymi towarzyszami, całkowicie rezygnując z realnych związków.

2. Chatboty oferują iluzję wsparcia emocjonalnego

Powszechne stało się wykorzystywanie chatbotów AI do celów psychoterapii. Platformy te czerpią wiedzę z zakresu zdrowia psychicznego z rozległych baz danych i imitują ludzką mowę za pomocą LLM. Ich porady mają charakter neutralny i ogólnikowy, jednak wiele osób preferuje korzystanie z tych narzędzi zamiast płacenia za sesje terapeutyczne.

Poza aspektem dostępności, niektórzy ludzie wolą także ufać bezstronnym algorytmom, które są wolne od ocen. Nie czują się komfortowo, zwierzając się ze swoich problemów innym osobom. Fakt, że rozmowa odbywa się z licencjonowanym specjalistą, nie zawsze eliminuje bariery komunikacyjne.

Niemniej jednak, traktowanie chatbotów AI jako substytut terapeutów jest niebezpieczne. Sztuczna inteligencja nie jest w stanie wczuć się w sytuację użytkownika ani zrozumieć jego emocji. Wykorzystuje NLP do analizy wprowadzanych danych i generuje odpowiednie odpowiedzi na podstawie zgromadzonych informacji. W przypadku potrzeby wsparcia w zakresie zdrowia psychicznego, konieczne jest skorzystanie z pomocy licencjonowanego terapeuty lub psychiatry.

3. Synteza mowy umożliwia naśladowanie głosów

Postęp w dziedzinie modeli syntezy mowy (tekstu na mowę i mowy na mowę) doprowadził do powstania tanich i łatwo dostępnych generatorów głosu AI. Są one w stanie generować mowę brzmiącą w sposób bardzo naturalny. Zależnie od jakości danych wejściowych i zaawansowania modelu, każdy może precyzyjnie sklonować głos dowolnej osoby.

Twórcy często wykorzystują generatory głosu AI do tworzenia lektorów do nagrań wideo, dodawania funkcji mowy do wirtualnych postaci lub programowania aplikacji sterowanych głosem. Jest to tańsze rozwiązanie niż tradycyjne nagrywanie. Niestety, generatory głosu bywają również wykorzystywane do naśmiewania się z innych osób i imitowania ich. Z pewnością wielu użytkowników internetu spotkało się z fałszywymi coverami piosenek, generowanymi przez AI.

Nie można jednak lekceważyć zagrożeń związanych z bezpieczeństwem, które wynikają z korzystania z generatorów głosu AI. Oszuści wykorzystują te narzędzia do rozpowszechniania fałszywych informacji oraz przeprowadzania ataków socjotechnicznych. Nawet osoby zaznajomione z technologią mogą dać się oszukać syntetyzowanym głosom, jeśli nie zachowają ostrożności.

Dostępność generatorów głosu, obrazu i tekstu, opartych na sztucznej inteligencji, umożliwia użytkownikom tworzenie zupełnie nowych tożsamości online. Doskonałym przykładem są wirtualni influencerzy. Wiele awatarów generowanych przez sztuczną inteligencję posiada niezwykle realistyczne cechy i na pierwszy rzut oka może być pomylonych z ludźmi.

Kreowanie realistycznych awatarów zbliża nas do koncepcji metaświata, ale jednocześnie ułatwia oszustom przeprowadzanie bardziej wyrafinowanych ataków. Tworzą fałszywe profile w celu kradzieży tożsamości lub oszustw matrymonialnych. Łącząc zaawansowane technologie z manipulacją psychologiczną, oszukują coraz większą liczbę ofiar.

Co gorsza, niektóre ofiary popadają w złudzenie, że mogą nawiązać autentyczne relacje z postaciami AI. Pragnienie towarzystwa bywa silniejsze od rozsądku. Decydują się ignorować fakt, że osoby, które stoją za tymi wirtualnymi profilami, w rzeczywistości nie dbają o ich dobro.

5. Treści generowane przez AI zalewają SERP

Chatboty AI wywarły znaczący wpływ na branżę tworzenia treści. Autorzy, agencje marketingowe, producenci treści, a nawet legalne publikacje badają sposoby wykorzystania sztucznej inteligencji do przyspieszenia procesu pisania. Zaawansowane LLM są bowiem w stanie wygenerować artykuł o długości 500 słów w czasie krótszym niż 15 sekund.

Istnieje szereg etycznych sposobów wykorzystania sztucznej inteligencji przez autorów. Problem polega na tym, że większość twórców chce przede wszystkim szybko produkować treści. Ta obsesja na punkcie szybkości odbija się negatywnie na jakości. Sztuczna inteligencja gromadzi dane z baz treningowych, ale nie weryfikuje faktów ani nie porównuje różnych źródeł. W rezultacie powstają treści, które często są nieoryginalne i wprowadzają w błąd.

Co gorsza, wiele artykułów stworzonych bez większego nakładu pracy, dzięki zaawansowanym technikom SEO, nadal osiąga wysokie pozycje w wynikach wyszukiwania. Większość użytkowników nawet nie zdaje sobie sprawy, że dane wyniki zostały wygenerowane przez sztuczną inteligencję. Mogą nieświadomie czytać i cytować fałszywe informacje.

6. Deepfake'i niszczą reputację

Modele generatywne oparte na sztucznej inteligencji potrafią imitować cechy, głosy i zachowania innych osób, wykorzystując do tego cyfrowo zmanipulowane media. Przykładem może być wideo na TikToku z „Tomem Cruisem”. Miliony ludzi uwierzyłyby, że jest autentyczne, gdyby na profilu nie pojawiła się informacja, że jest to fałszywy film.

Niestety, nie wszyscy są tak uczciwi. Oszuści wykorzystują fałszywe nagrania wideo do rozpowszechniania wprowadzających w błąd, szkodliwych lub dwuznacznych treści o charakterze seksualnym. Dzięki odpowiednim umiejętnościom i narzędziom do edycji są w stanie stworzyć niemal dowolny klip.

7. Wirtualna rzeczywistość zniekształca zmysły

Modele AI wspomagają rozwój technologii wirtualnej (VR) i rozszerzonej rzeczywistości (AR), oferując coraz bardziej wciągające wrażenia. Ich hiperrealistyczne kreacje doskonale stymulują zmysły. Wraz z postępem technologii VR/AR, poprawie ulegają również standardy bodźców dźwiękowych, wizualnych i dotykowych.

Mimo że wirtualna rzeczywistość jest fascynująca, zbyt częste przebywanie w niej może zniekształcać naturalne zmysły. Platformy VR/AR odrywają nas od rzeczywistego otoczenia. Zbyt duża ekspozycja na sztuczne bodźce sensoryczne może utrudnić odróżnianie tego, co prawdziwe, od symulacji.

Niektórzy użytkownicy wykazują nawet nadmierną zależność od wirtualnej rzeczywistości. Zamiast stawiać czoła realnemu światu, przenoszą się do symulacji, które są dostosowane do ich potrzeb, wymagań i preferencji.

8. Systemy biznesowe oparte na sztucznej inteligencji kreują nierealistyczne oczekiwania dotyczące zysków

Sztuczna inteligencja zmienia sposób, w jaki funkcjonują firmy z różnych sektorów. Jak informuje Fox, 90 procent małych firm już włączyło chatboty AI do swoich procesów pracy. Także specjaliści z branży technologicznej analizują bardziej zaawansowane modele.

Oczywiście, firmy mogą zwiększyć produktywność, wykorzystując automatyzację opartą na sztucznej inteligencji, jednak poleganie wyłącznie na tych systemach wiąże się z ryzykiem nadmiernych inwestycji. Systemy AI na pełną skalę są kosztowne. Nieprzygotowane wdrożenie sztucznej inteligencji może jedynie zwiększyć koszty ogólne, utrudniając zwrot z inwestycji.

Sztuczna inteligencja nie jest panaceum na wszelkie problemy. Niedoinformowani przedsiębiorcy powinni porzucić błędne przekonanie, że zastąpienie pracowników ludzkich sztuczną inteligencją automatycznie zwiększy zyski. Wdrożenie nowych systemów może prowadzić do strat, jeśli zabraknie odpowiedniego planowania.

Wyznaczanie granicy między fantazją a rzeczywistością

W miarę postępu technologii AI, odróżnianie świata wirtualnego od rzeczywistości stanie się coraz trudniejsze. Zaawansowane modele będą w stanie generować jeszcze bardziej realistyczne efekty. Jedynym sposobem na obronę przed powszechną iluzją jest samodzielne zgłębianie wiedzy na temat sztucznej inteligencji – analizowanie jej funkcji i ograniczeń.

Zawsze należy podchodzić do sztucznej inteligencji z dozą sceptycyzmu. Choć poczyniła ona znaczący postęp, nadal nie zastąpi właściwych badań i zdrowego rozsądku. Ślepe zaufanie platformom AI naraża nas na dezinformację.