Co to jest zrozumiała sztuczna inteligencja (XAI) i dlaczego warto się tym przejmować

W dynamicznie rozwijającym się świecie, gdzie dane odgrywają kluczową rolę, sztuczna inteligencja (AI) staje się centralnym punktem zainteresowania wielu firm. Wyjaśnialna sztuczna inteligencja, w skrócie XAI, to koncepcja zyskująca na popularności. Pomaga firmom interpretować i wyjaśniać działanie modeli sztucznej inteligencji i uczenia maszynowego, które są wykorzystywane w coraz większej liczbie operacji w różnych sektorach. Te technologie przyspieszają rozwój i usprawniają działanie przedsiębiorstw. XAI pomaga zrozumieć, jak modele AI generują wyniki. Zastanawiasz się, dlaczego warto zainteresować się XAI? Ten artykuł jest właśnie dla Ciebie!

Zacznijmy!

Czym jest Wyjaśnialna Sztuczna Inteligencja?

Wyjaśnialna sztuczna inteligencja (XAI) to zbiór technik i procedur, które mają na celu pomóc użytkownikom w zrozumieniu i zaufaniu do rezultatów dostarczanych przez modele AI. W praktyce, XAI umożliwia wgląd w działanie złożonych algorytmów uczenia maszynowego, pozwalając zrozumieć logikę stojącą za ich decyzjami. XAI wprowadza warstwę przejrzystości do modeli AI, co pozwala zrozumieć podstawy prognoz. Jest to szczególnie korzystne w firmach, gdzie AI jest wykorzystywane na różne sposoby. Zwiększa to dokładność, efektywność i transparentność tych modeli.

Dodatkowo, XAI pomaga identyfikować potencjalne uprzedzenia i problemy, które mogą pojawić się w złożonych algorytmach uczenia maszynowego. Modele typu "czarna skrzynka", wynikające ze skomplikowanych algorytmów, są trudne do zrozumienia, nawet dla analityków danych, którzy je tworzą. Przejrzystość oferowana przez XAI jest więc kluczowa dla organizacji, chcących w pełni wykorzystać potencjał sztucznej inteligencji i podejmować świadome decyzje. XAI oferuje wyjaśnienia najczęściej w formie tekstowej lub graficznej, dając wgląd w wewnętrzne funkcjonowanie modeli AI.

Oprócz tego, XAI stosuje mechanizmy takie jak analiza ważności cech, uproszczone wyjaśnienia i objaśnianie na przykładach. Zapotrzebowanie na XAI dynamicznie rośnie, w miarę jak firmy coraz częściej wdrażają te rozwiązania w swoich ekosystemach. Wraz z rozwojem tej dziedziny, ewoluują też techniki i procesy wyjaśniania.

Znaczenie XAI

Obecnie wiele firm opiera swoje operacje biznesowe na modelach AI. Decyzje strategiczne są często podejmowane na podstawie przewidywań AI. Jednak modele te nie są idealne i często popełniają błędy. Uprzedzenia mogą wynikać z różnych czynników, wpływając na decyzje podejmowane przez AI. Co istotne, dokładność decyzji AI może spadać, jeśli model jest zasilany danymi produkcyjnymi, które różnią się od danych treningowych.

Co więcej, interpretacja modeli uczenia maszynowego i sieci neuronowych bywa wyzwaniem. Analitycy danych nie zawsze potrafią zrozumieć, jak dokładnie działają te algorytmy. Zbyt duże zaufanie do każdej decyzji AI, może skutkować poważnymi problemami. Dlatego tak istotne jest, aby firmy w pełni rozumiały proces decyzyjny AI i logikę, która stoi za każdym wynikiem. Tutaj właśnie pojawia się XAI jako użyteczne narzędzie. Pomaga firmom w uzyskaniu pełnego wyjaśnienia procesu decyzyjnego modelu AI, wraz z uzasadnieniem jego decyzji.

XAI wspomaga monitorowanie działania algorytmów uczenia maszynowego, sieci neuronowych i głębokiego uczenia. Ułatwia ocenę dokładności i zasadności każdej decyzji, co pozwala stwierdzić, czy dane rozwiązanie jest odpowiednie dla firmy. XAI stanowi niezbędny element, który pomaga we wdrożeniu odpowiedzialnego modelu AI, który podejmuje sprawiedliwe i trafne decyzje. Ważne jest również to, że XAI zwiększa zaufanie użytkowników i minimalizuje ryzyko związane z bezpieczeństwem i zgodnością.

Jak działa XAI?

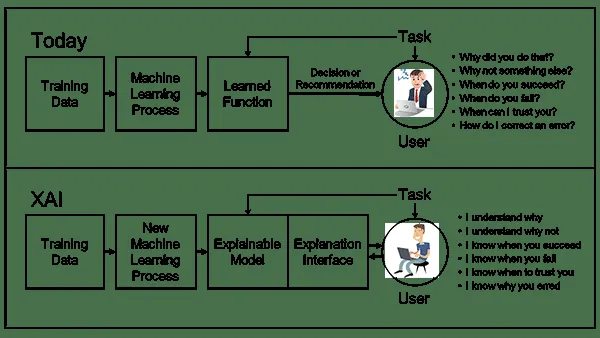

Nowoczesne systemy AI dostarczają wyniki lub podejmują decyzje za pomocą różnych modeli, często bez wyjaśnienia, w jaki sposób doszły do danego wniosku. Aby zlikwidować tę lukę, firmy wdrażają XAI. Wykorzystuje ona model wyjaśniający i informacje z metadanych, które są prezentowane przez interfejs, aby ułatwić zrozumienie procesu decyzyjnego AI.

Źródło obrazu: Darpa

Źródło obrazu: Darpa

Metody AI są wprowadzane na różnych poziomach, takich jak uczenie maszynowe (ML), rozumowanie maszynowe (MR) oraz integracja między MR i ML. Komponenty, które XAI wprowadza do modelu AI, to wyjaśnienie, wytłumaczalność danych, wytłumaczalność MR i wytłumaczalność ML. XAI wprowadza również interpretowalność i wyjaśnialność w kontekście integracji między MR i ML.

Działanie XAI można podzielić na trzy kategorie:

- Dane podlegające wyjaśnieniu: XAI analizuje dane użyte do trenowania modelu, wskazując przyczyny wyborów, proces selekcji i raporty dotyczące działań mających na celu eliminację uprzedzeń.

- Prognozy podlegające wyjaśnieniu: XAI prezentuje funkcje, na podstawie których model AI dokonał wyboru.

- Algorytmy podlegające wyjaśnieniu: XAI ujawnia wszystkie warstwy modelu AI i wyjaśnia, jak każda z nich przyczynia się do uzyskania ostatecznego wyniku.

Warto zauważyć, że wyjaśnianie prognoz i algorytmów wciąż jest w fazie rozwoju. Obecnie, do wyjaśniania sieci neuronowych najczęściej wykorzystuje się analizę danych.

Do wyjaśnienia procesu decyzyjnego XAI wykorzystuje dwa podejścia:

- Modelowanie zastępcze: W tym podejściu wykorzystuje się uproszczony model, który jest przybliżeniem oryginału. Może to prowadzić do nieznacznie innych wyników, niż te, które uzyskałby oryginalny model.

- Projektowanie ukierunkowane na interpretację: W tym podejściu XAI buduje model, który jest łatwy do zrozumienia dla użytkowników. Modele te mogą być jednak mniej dokładne niż modele oparte o złożone algorytmy.

Korzyści płynące z XAI

Wyjaśnialna sztuczna inteligencja odgrywa istotną rolę w rozwoju sztucznej inteligencji, ułatwiając ludziom zrozumienie mechanizmów działania tych systemów. Przynosi to szereg korzyści:

Wzrost przejrzystości i zaufania

Firmy, które wdrażają modele AI, mogą dzięki XAI lepiej zrozumieć, jak działają te złożone algorytmy i dlaczego generują konkretne wyniki. XAI ułatwia zrozumienie przyczyn działania modeli typu czarna skrzynka, co buduje zaufanie pomiędzy człowiekiem a maszyną.

Lepsza adaptacja modeli AI

Gdy organizacje rozumieją procesy i logikę modeli AI, wzrasta tempo ich adaptacji. Dzięki XAI, firmy mogą bardziej ufać decyzjom generowanym przez AI.

Wzrost produktywności

Dzięki XAI zespoły odpowiedzialne za operacje uczenia maszynowego (MLOps) mogą łatwo identyfikować błędy i obszary wymagające poprawy w systemach AI. XAI pomaga utrzymać płynność i efektywność procesów AI. Zespół MLOps, dzięki XAI, rozumie logikę prowadzącą model AI do określonych wyników, co zwiększa produktywność.

Redukcja ryzyka i kosztów

XAI odgrywa kluczową rolę w obniżaniu kosztów zarządzania modelami AI. Dzięki jasnym wyjaśnieniom, XAI minimalizuje potrzebę ręcznych kontroli i ryzyko kosztownych błędów, które mogłyby negatywnie wpłynąć na relacje z klientami.

Odkrywanie nowych możliwości

Gdy zespoły techniczne i biznesowe zyskują wgląd w procesy decyzyjne AI, mogą identyfikować nowe możliwości. Dokładna analiza wyników AI może ujawnić aspekty, które wcześniej umykały uwadze.

Wyzwania związane z XAI

XAI nie jest pozbawione wyzwań:

- Trudność w interpretacji: Niektóre systemy uczenia maszynowego są trudne do interpretacji, a co za tym idzie, wyjaśnienia XAI mogą być trudne do zrozumienia dla użytkowników. Strategia "czarnej skrzynki", która uniemożliwia wgląd w mechanizmy działania AI, może powodować problemy operacyjne i etyczne.

- Uczciwość: XAI ma trudności z określeniem, czy dana decyzja AI jest sprawiedliwa. Uczciwość jest subiektywna i zależy od danych, na których model został wytrenowany.

- Bezpieczeństwo: Klienci mogą próbować wpływać na proces decyzyjny modelu ML i manipulować wynikami dla własnych korzyści. Ponadto, każda osoba z dostępem technicznym może odzyskać dane użyte do treningu algorytmu.

Różnica między XAI a AI

Choć XAI i AI są ze sobą powiązane, istnieją między nimi fundamentalne różnice.

XAI wyjaśnia logikę procesu decyzyjnego złożonych modeli ML, natomiast AI dostarcza jedynie wynik decyzji. XAI zwiększa zaufanie do modeli AI, dzięki jasnym wyjaśnieniom. W przypadku AI, użytkownicy nie rozumieją, jak doszło do określonego wyniku. XAI minimalizuje uprzedzenia, które są często obecne w modelach AI, które mogą podejmować decyzje na podstawie nieobiektywnych danych. XAI zmniejsza ryzyko błędów popełnianych przez systemy AI. Modele AI nie są w 100% dokładne i mogą dokonywać błędnych prognoz. Jeśli model AI dokona błędnej prognozy, może to skutkować stratami dla firmy. XAI wciąż ewoluuje, szczególnie w kontekście wyjaśniania złożonych modeli typu "czarna skrzynka". Natomiast AI jest szeroko rozwinięta i może rozwiązywać wiele problemów bez większych trudności. XAI, poprzez wyjaśnianie każdego etapu procesu decyzyjnego, potencjalnie otwiera drogę do manipulacji tymi procesami. Modele AI, nie ujawniając szczegółowej logiki, są trudniejsze do zmodyfikowania.

Wpływ XAI na różne sektory

Pojawienie się XAI wywarło znaczący wpływ na różne sektory, w których sztuczna inteligencja odgrywa kluczową rolę w procesie podejmowania decyzji. Oto kilka przykładów:

Finanse

Sektor finansowy intensywnie wykorzystuje AI. XAI odgrywa kluczową rolę w procesach audytowych, wyjaśniając powody podejmowanych decyzji finansowych. Zwiększa to zaufanie użytkowników do instytucji finansowych.

Opieka zdrowotna

XAI wspiera systemy opieki zdrowotnej, ułatwiając diagnostykę, wykrywanie przyczyn chorób i dobór odpowiedniego leczenia.

Produkcja

W sektorze produkcyjnym, modele AI są stosowane w zarządzaniu, naprawach i logistyce. XAI pomaga rozwiązywać problemy z zaufaniem do modeli AI, wyjaśniając logikę podejmowanych decyzji.

Motoryzacja

W samochodach autonomicznych XAI jest kluczowe, pozwalając pojazdom wyjaśniać decyzje podejmowane w sytuacjach awaryjnych. Dzięki analizie różnorodnych sytuacji i wypadków, XAI wspomaga autonomiczne samochody w podejmowaniu bezpieczniejszych decyzji.

Materiały edukacyjne

Jeśli chcesz dowiedzieć się więcej o XAI, warto rozważyć następujące zasoby:

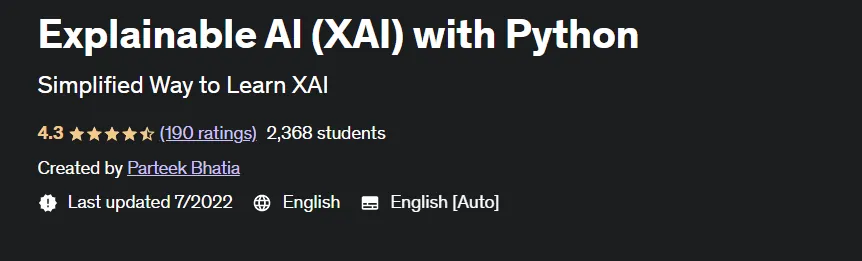

Wytłumaczalna sztuczna inteligencja z Pythonem

Kurs na platformie Udemy, prowadzony przez Parteeka Bhatia, prezentuje różne aspekty XAI, w tym aplikacje, techniki XAI i narzędzia What-if od Google.

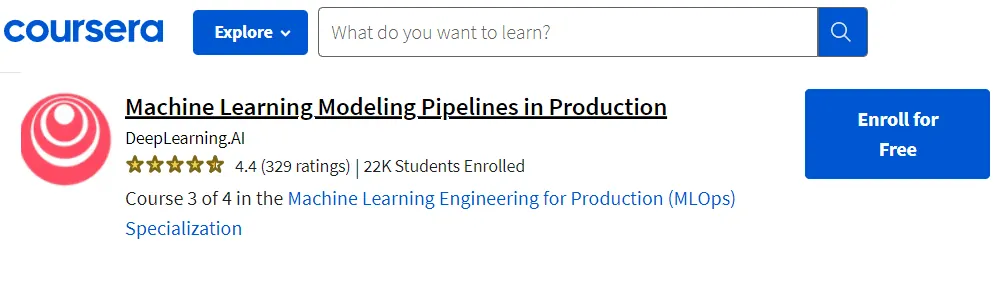

Potoki modelowania uczenia maszynowego

Kurs oferowany przez Coursera, prowadzony przez Roberta Crowe, uczy jak wdrażać narzędzia i techniki zarządzania zasobami modelowania. Zawiera lekcje dotyczące analizy modelu i jego interpretacji.

Wyjaśnialna sztuczna inteligencja

Książka napisana przez Udaya Kamatha i Johna Liu, poświęcona interpretowalności w uczeniu maszynowym. Zawiera wiele studiów przypadków i praktycznych przykładów, które ułatwiają zrozumienie XAI.

Praktyczna sztuczna inteligencja (XAI) z Pythonem

Książka autorstwa Denisa Rothmana, która szczegółowo omawia narzędzia i techniki XAI, niezbędne w nowoczesnych firmach. Porusza również kwestie związane z uprzedzeniami w sztucznej inteligencji.

Podsumowanie

Wyjaśnialna sztuczna inteligencja to dynamicznie rozwijająca się dziedzina, która ułatwia zrozumienie procesu decyzyjnego modeli AI. XAI pomaga interpretować skomplikowane modele ML, które wcześniej były nieprzeniknione nawet dla ekspertów od danych. Choć XAI poczyniło postępy, nadal istnieją obszary wymagające ulepszeń. Mamy nadzieję, że ten artykuł przybliżył Ci koncepcję XAI, jego działanie, korzyści, wyzwania i zastosowania. Zachęcamy do zapoznania się z wymienionymi kursami i książkami, aby pogłębić swoją wiedzę na temat XAI. Warto również zapoznać się z tematyką Sztucznej Wąskiej Inteligencji (ANI).